Bonjour à tous et bienvenue dans cet épisode hors-série !

Avant de commencer, je tiens à te dire que je suis content de te retrouver pour ce nouvel épisode de la newsletter. Vous êtes actuellement 1615 lecteurs ! Je souhaite la bienvenue aux nouveaux et je tiens à tous vous remercier pour votre confiance.

Si on t’a transféré cet e-mail, sache que tu peux t’inscrire gratuitement à cette newsletter en cliquant sur le bouton ci-dessous 👇

Avant de commencer, petit point sur la newsletter. Comme tu auras pu le remarquer, je n’ai pas couvert les résultats ce trimestre et ça fait un moment que je n’ai pas publié d’épisode. Pas de panique, c’est seulement que je suis pris par des obligations personnelles, et, comme la newsletter reste un hobby, je l’ai mis en suspens.

Bon, tu l’auras probablement remarqué mais les cours de bourse sur le secteur de la tech dévissent 📉 . Entre Microsoft, Amazon, Google et les semi-conducteurs, ces deux dernières semaines ont été sportives… Dans ce petit billet d’humeur, je vais revenir sur les actualités 🆕 et essayer de décortiquer pour toi ce qu’il se passe sur les marchés.

Les CapEx

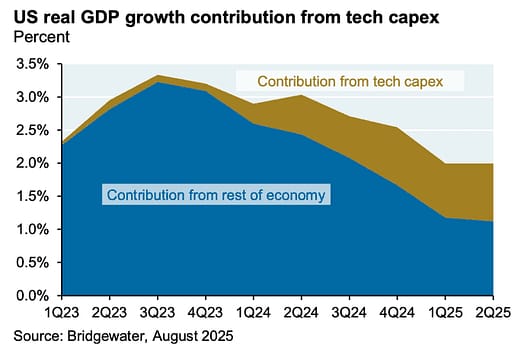

Les CapEx, les CapEx, les CapEx… On entend que ce mot dans la bouche des analystes depuis quelques trimestres maintenant, et à raison puisque c’est devenu le principal facteur de croissance 📈 de l’économie américaine.

Les CapEx (Capital Expenditures), pour ceux qui ne le savent pas, ce sont les dépenses d’investissements d’une entreprise 🏭 . Aujourd’hui, quand on parle de CapEx dans la tech, on fait souvent référence aux dépenses d’investissements des hyperscalers (Google, Microsoft, Amazon, Meta et dans une moindre mesure, Oracle) dans les datacenters, notamment IA.

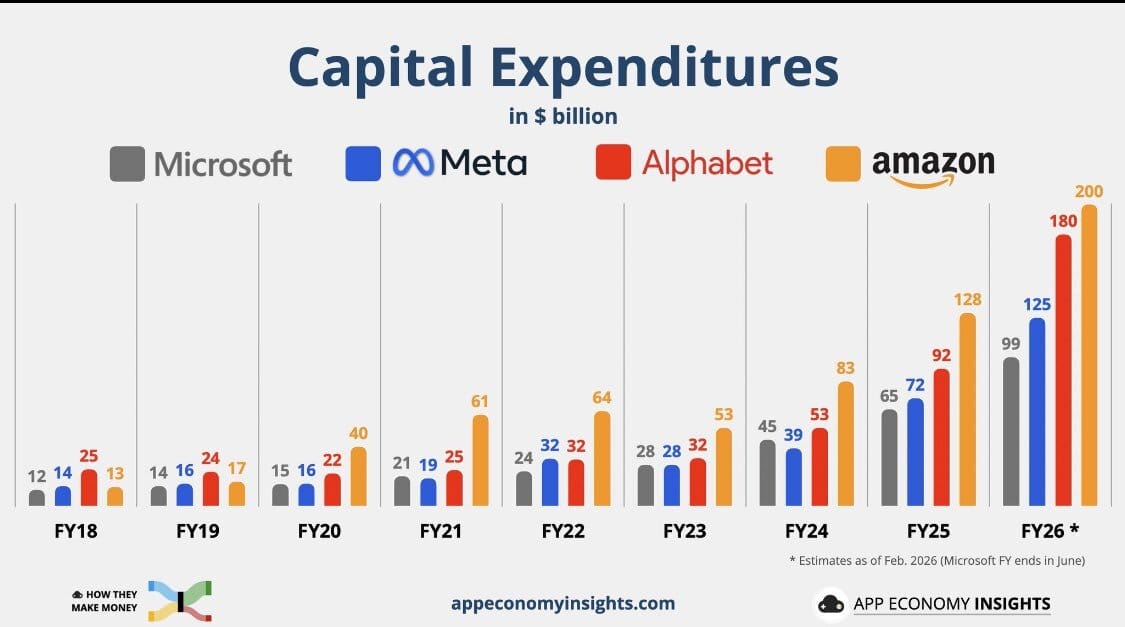

Ces fameux CapEx inquiétaient déjà les marchés, avec des montants jugés pharamineux, hors de toute réalité économique. Sauf que voilà, suite à cette saison de publications, on apprend que les Big Tech prévoient de quasiment doubler 🚀 leurs CapEx sur 2026 par rapport à 2025…

Le marché anticipait déjà une forte hausse des CapEx, mais ce n’est rien face à ce qui a été annoncé. Pour une fois d’ailleurs, ce n’est pas Microsoft qui a mené la danse.

Microsoft et Meta ont tous les deux ouvert le bal avec des dépenses sur le 4e trimestre 2025 (2e trimestre fiscal 2026 pour Microsoft) à 37.5B$ et 22.14B$ respectivement, avec des anticipations sur 2026 dans les 150B$ 💥 pour Microsoft (en restant sur la trajectoire actuelle) et entre 115 et 135B$ pour Meta.

S’en sont suivis de Google puis Amazon qui ont à leur tour annoncé des dépenses records, avec 27.85B$ et 39.52B$ respectivement, et des anticipations sur 2026 entre 175 et 185B$ 💥 pour Google et à 200B$ pour Amazon 🤯.

Tous ont largement excédé les anticipations, qui, je le rappelle étaient de 110B$ pour Meta (+14% vs consensus), de 119B$ pour Google (+51% vs consensus 🚀 ) et de 145B$ pour Amazon (+38% vs consensus).

Le marché a immédiatement sanctionné les titres, sauf Meta qui avait déjà été impactée au trimestre dernier. Malgré les très bons chiffres, la réaction du marché reste logique.

En effet, ces montants colossaux vont avoir un impact fort 📉 sur les Free Cash Flows (Flux de Trésorerie Disponibles) de ces entreprises en 2026, qui risquent d’ailleurs d’afficher des FCF négatifs sur l’an prochain.

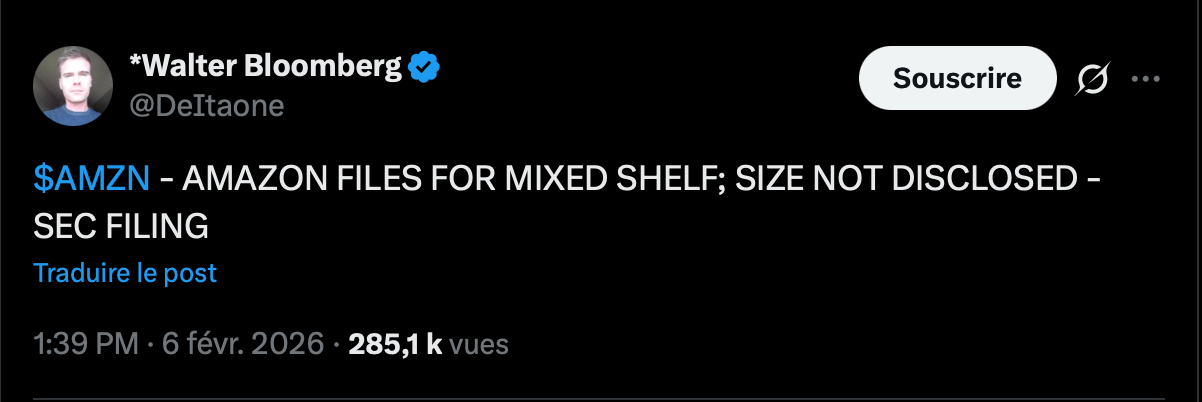

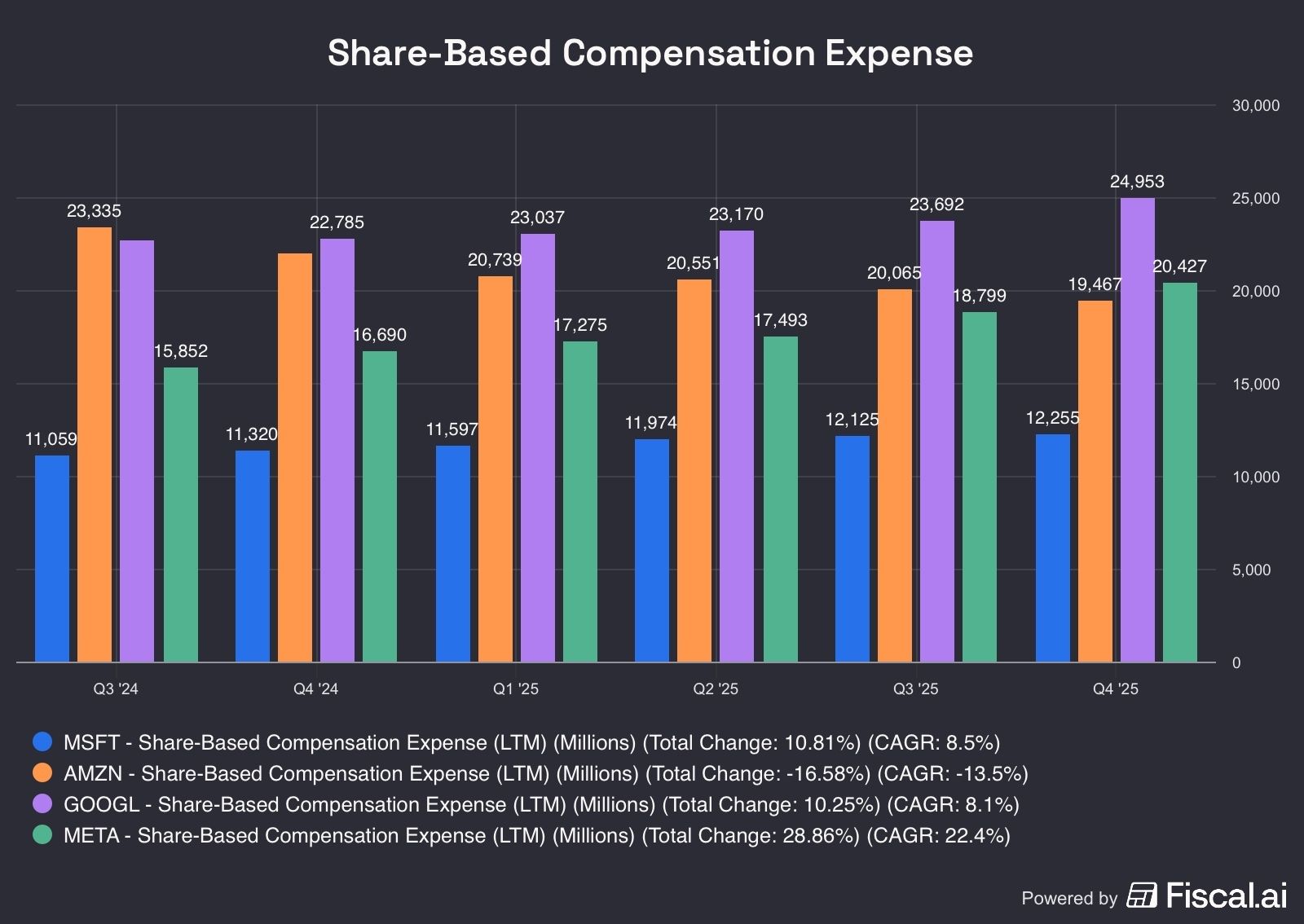

Ces CapEx vont aussi impacter les bénéfices long terme avec des dépenses de dépréciations importantes. Il y a fort à parier que les programmes de rachats d’actions se voient aussi suspendus, ce qui implique une potentielle dilution des actionnaires, ne serait-ce que par le biais des SBC (Share Based Compensation).

Certains acteurs vont devoir avoir recours à la dette, voire à l’émission de titres, et c’est le cumul de tous ces facteurs qui inquiète 😟 particulièrement le marché. Amazon a d’ailleurs d’ores et déjà déposé une requête à la SEC (l’autorité des marchés américaine) pour pouvoir émettre des obligations et des actions dans un but de financement.

Faut-il s’inquiéter ?

Alors effectivement, face à de tels montants, et surtout face à ce qu’ils impliquent, il est normal de se poser quelques questions. Cependant, je ne pense pas (encore) qu’il y ait lieu de s’inquiéter.

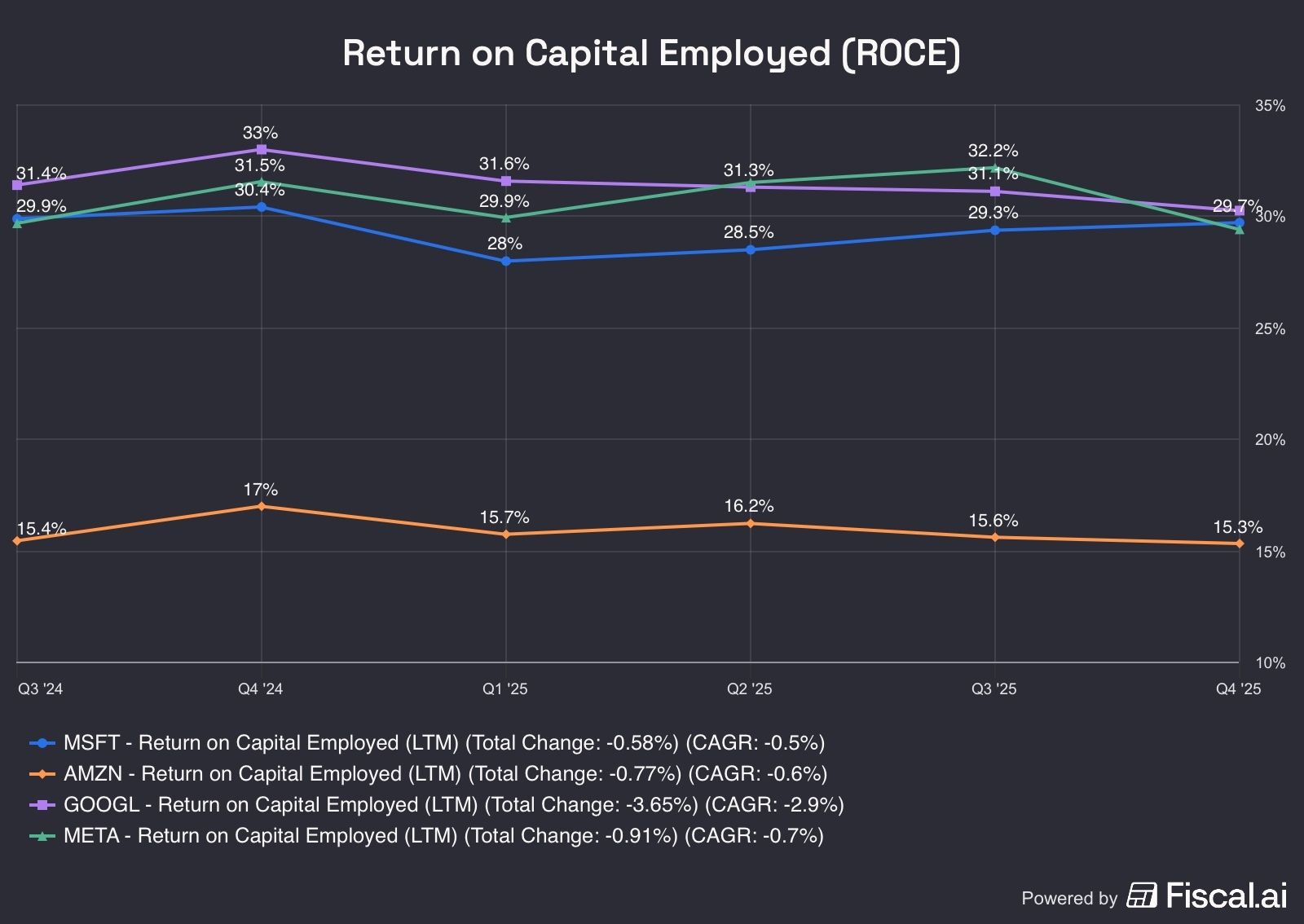

Quid de la rentabilité

Premièrement, sur la rentabilité de ces dépenses. Actuellement, on n’observe aucune baisse de la rentabilité des entreprises citées 🟢 . Cela fait maintenant plusieurs trimestres que ces entreprises dépensent (presque) sans compter, et si le cloud IA n’était pas rentable, on le verrait d’ores et déjà dans les chiffres, mais ce n’est pas le cas.

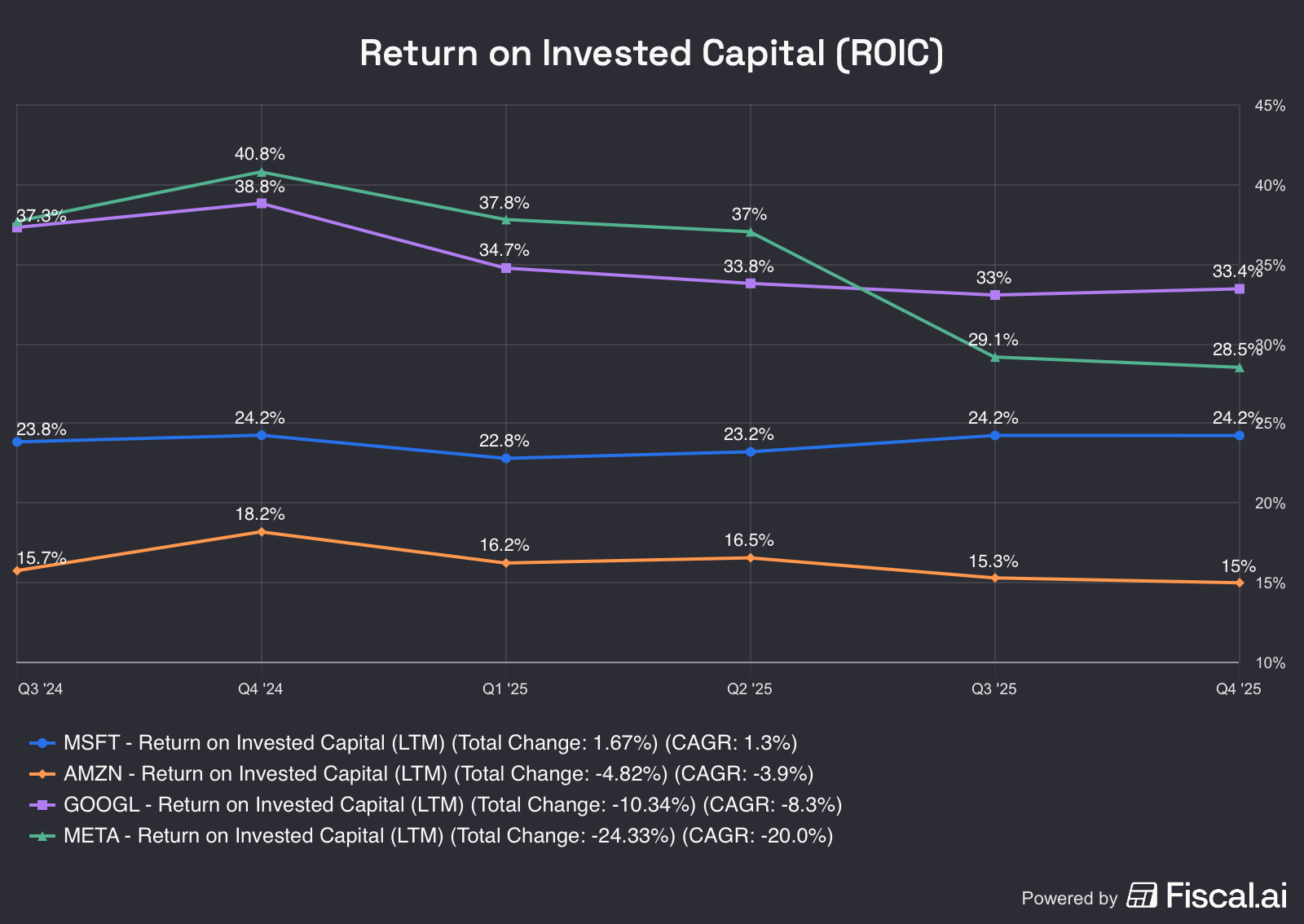

Que ce soit du côté du ROCE ou du ROIC, on peut observer qu’il se maintiennent parfaitement sur 12 mois glissants, sauf du côté du ROIC de Meta qui lui subit une baisse.

Cependant, tout ça peut s’expliquer assez facilement. Meta est ici le seul acteur qui ne monétise pas directement ses capacités de calcul (uniquement indirectement par la publicité et autres services), ce qui fait que les dépenses pèsent plus fortement sur la rentabilité.

Meta perd aussi beaucoup d’argent avec sa division Reality Labs, et c’est aussi pour cette raison que Zuckerberg a pris la décision de fortement réduire ⏬ les investissements sur cette branche.

La croissance portée par l’IA

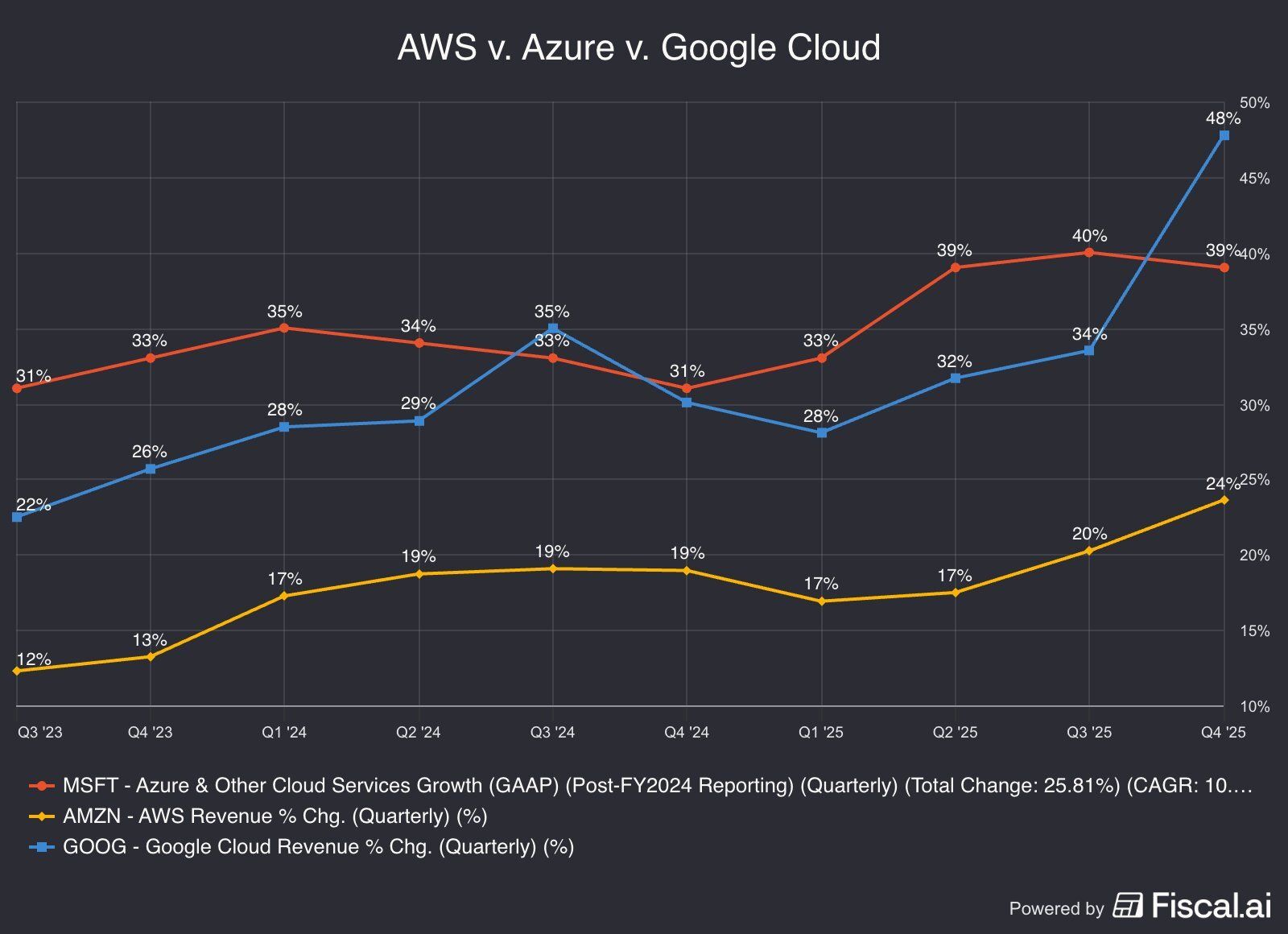

De plus, si l’on regarde la croissance 📈 , elle est clairement au rendez-vous. On observe depuis plusieurs trimestres une ré-accélération de cette dernière chez AWS, Azure et GCP.

Cette croissance est clairement portée par le cloud IA 🤖 et les investissements dans de nouvelles capacités de calcul. Il n’y a d’ailleurs qu’à écouter le discours des CEOs lors de la publication des résultats pour comprendre qu’il n’y a aujourd’hui pas assez de capacités pour répondre à la demande.

Pour ce qui est de Microsoft, la baisse de la croissance d’Azure sur ce trimestre est due à un choix d’allocation stratégique de la puissance de calcul. En effet, la CFO de Microsoft, Amy Hood, a expliqué qu’ils avaient privilégié les projets internes plutôt que la monétisation externe. Sans ça, ils auraient fait bien plus que 39% de croissance sur Azure ce trimestre.

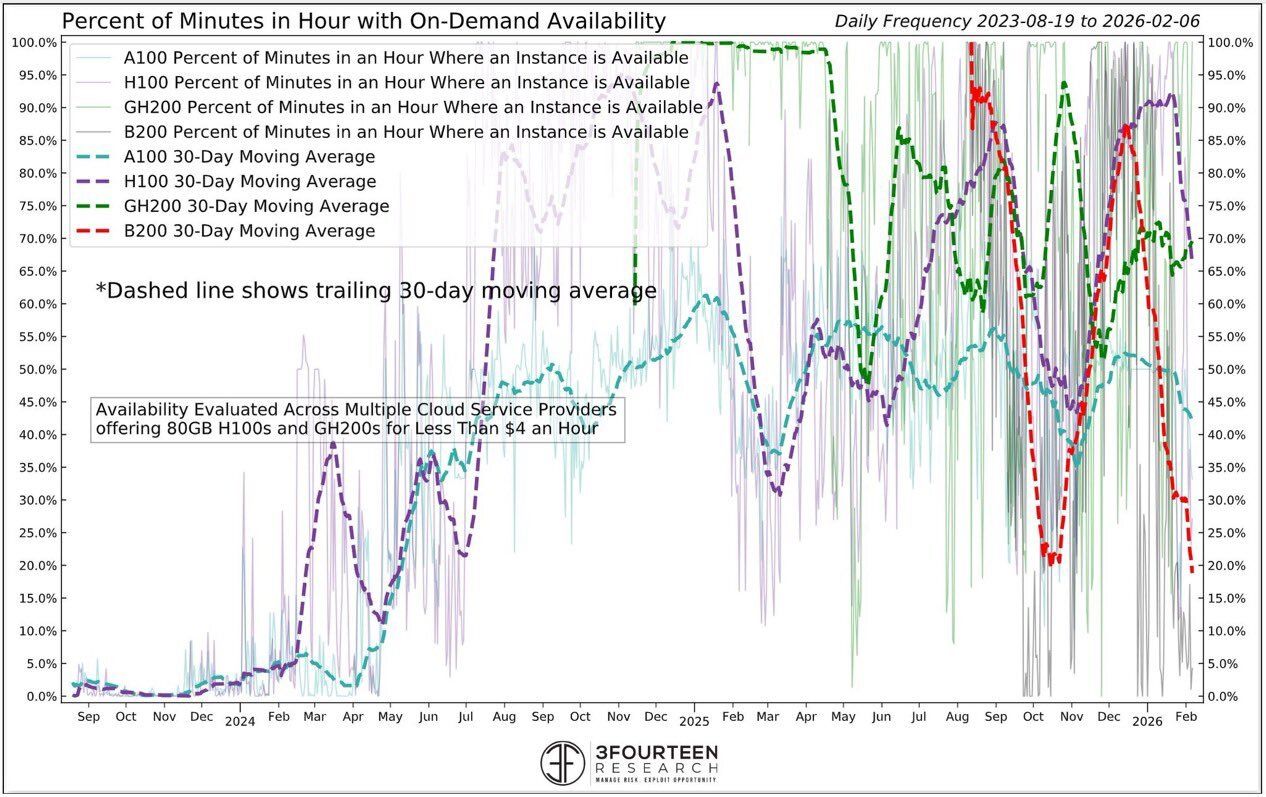

Pour confirmer cela, on peut voir que la disponibilité des GPUs baisse drastiquement ⬇ depuis quelques semaines, sans parler des diverses augmentations de prix à la location que l’on a pu voir chez plusieurs CSP (Cloud Service Providers).

Et la dette/dilution dans tout ça ?

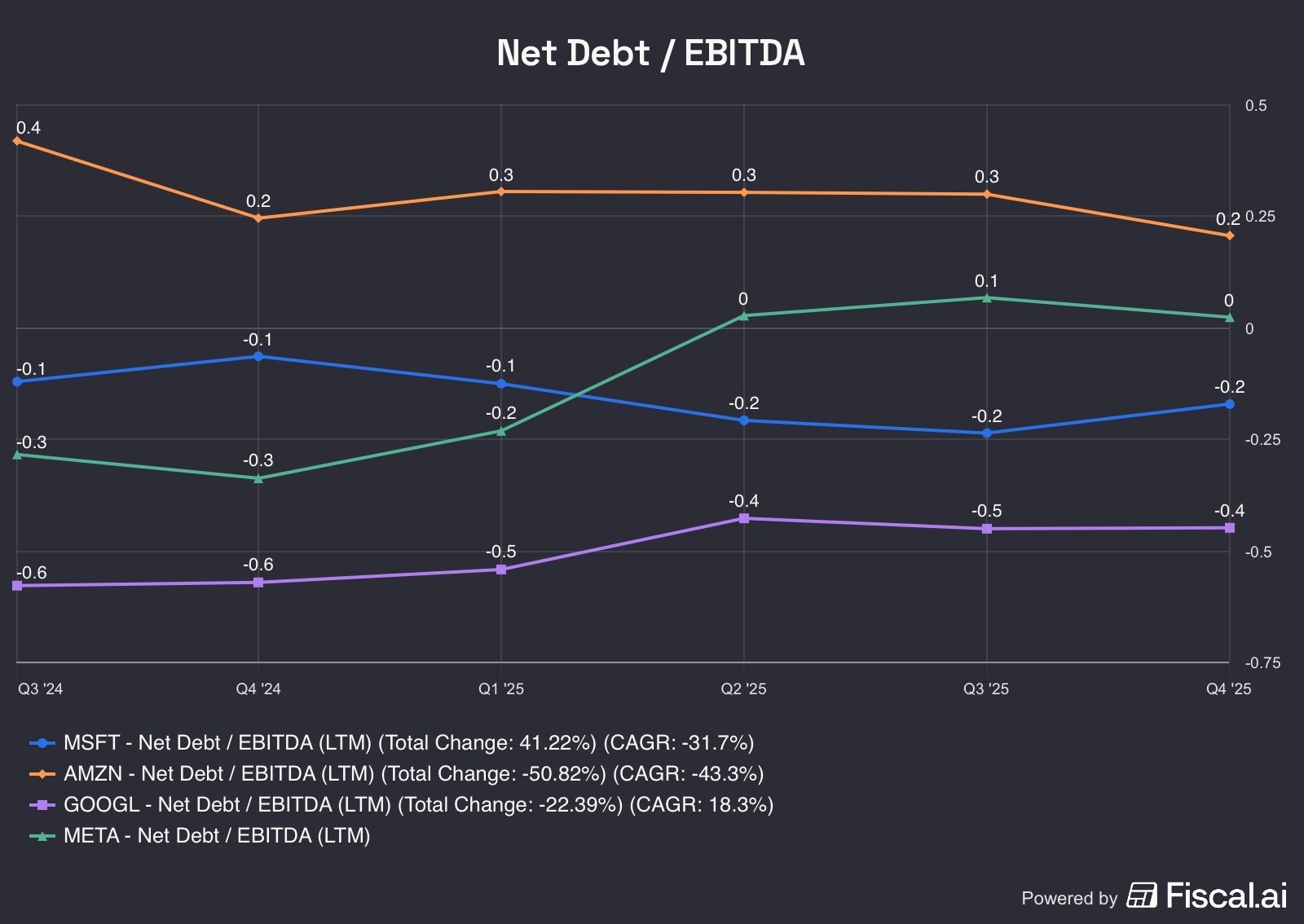

Malgré tout cela, on a parlé ni de la dette ni de la dilution… Concernant la dette, c’est selon moi un non sujet pour le moment, en tout cas sur ces 4 acteurs particulièrement (Amazon, Alphabet, Microsoft et Meta) car ils sont assez peu endettés 🟢 .

Seul Amazon a une dette nette positive (et de vraiment pas beaucoup), les 3 autres ayant soit aucune dette (mis en face des actifs liquides), soit du cash en réserve.

Par ailleurs, si l’on se fie à la notation de crédit de Standard & Poors pour ces 4 entreprises, on est sur une solidité financière assez irréprochable 🟢 , avec AAA pour Microsoft, AA+ pour Google, AA- pour Meta et AA pour Amazon.

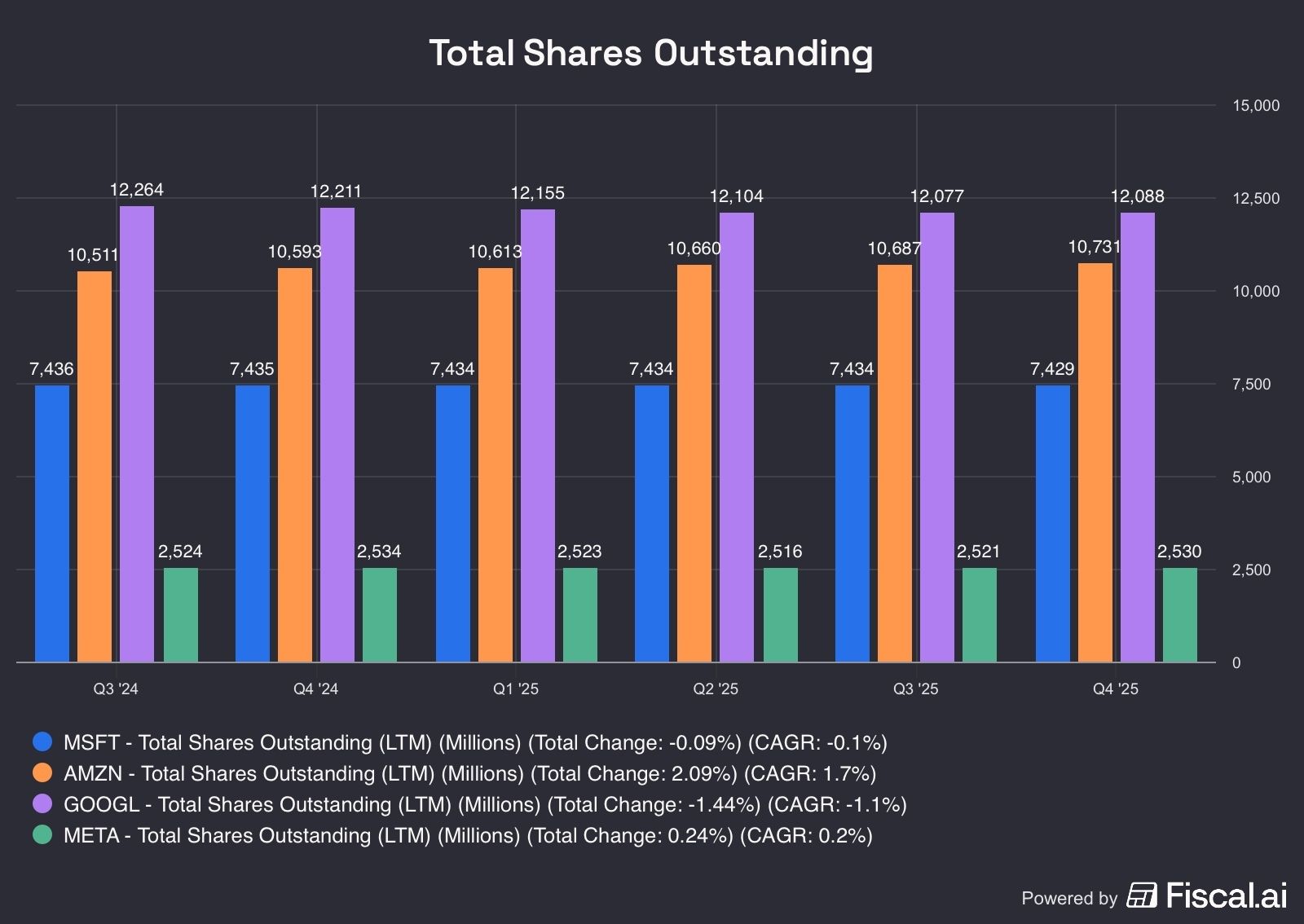

De même sur la dilution, elle resterait marginale. Actuellement, à part chez Meta et Amazon, le nombre d’actions en circulation est à la diminution.

Si demain, ces entreprises devaient couper tout rachat d’actions, la dilution serait de l’ordre d’1 à 2% par an grand maximum, quand on compare la taille de ces entreprises face aux SBC (quelques dizaines de milliards de dollars par an face à plusieurs billions de dollars de valorisation).

Sans compter qu’avec la croissance des revenus 📈 , les FCF devraient remonter mécaniquement et donc compenser la croissance des CapEx (jusqu’à un certain point, certes) ainsi que la dilution.

Les business models du cloud

Jusqu’ici, j’ai surtout abordé la situation financière de ces géants du cloud mais je n’ai pas vraiment expliqué pourquoi ils engageaient des dépenses si importantes 💰 dans leurs capacités de calcul.

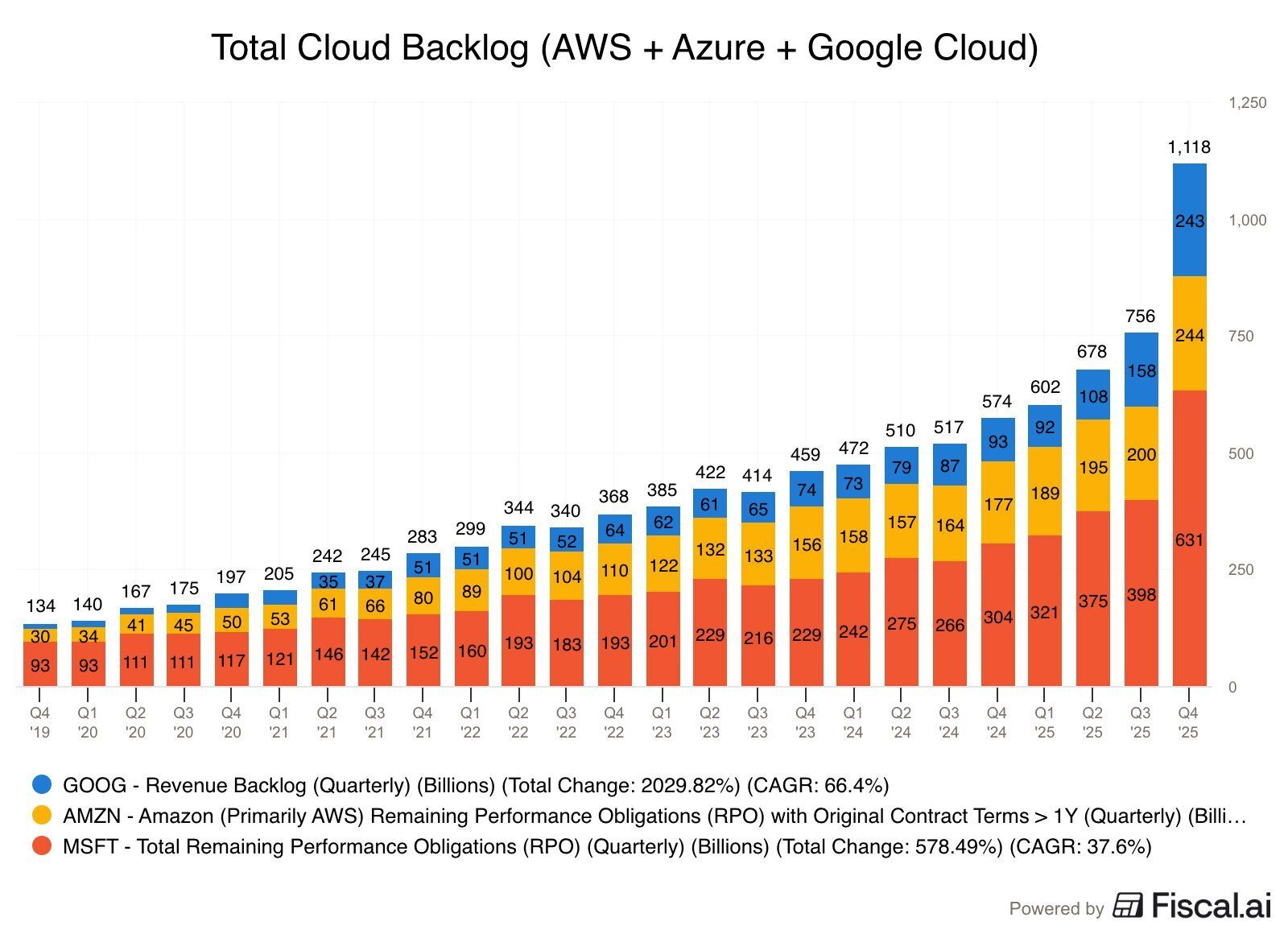

Car oui, outre le fait que cela accélère la croissance 📈 , il y a aussi une raison bien plus pragmatique derrière. Et pour ça, il faut que je parle des RPO, ou Remaining Performance Obligations.

Dans le business du cloud, il y a deux modèles de rémunération: le pay-as-you-go, où la capacité est louée temporairement ⏱ , un peu comme la location d’un film sur une plateforme de streaming, et les contrats pluri-annuels.

Et ce qui nous intéresse ici, c’est justement la deuxième option. Les RPO sont des contrats pluri-annuels où le fournisseur s’engage à mettre à disposition du client une certaine capacité de calcul 💻 , et où le client s’engage à consommer un minimum de crédits chez le fournisseur de cloud ☁ .

Mais plutôt que de faire une longue explication, prenons un exemple:

L’entreprise A contracte auprès d’AWS un contrat de location de 150k GPUs sur 2 ans et de 200k GPUs sur la 3e année, le tout accompagné de différents services (dont du stockage, des services d’API, etc…), ce qui fait un total de 50B$ sur 3 ans avec 15B$ sur l’année 1 et 2, et 20B$ sur l’année 3.

L’entreprise A s’engage à utiliser au moins 30% de la capacité commandée, ce qui correspond à un coût de 4.5B$ sur l’année 1 et 2, et de 6B$ sur l’année 3. Sinon, en compensation, l’entreprise A se verra dans l’obligation de verser un dédommagement à AWS.

En contrepartie, AWS s’engage à rendre à disposition de l’entreprise A 150k GPUs sur l’année 1 et 2, et 200k GPUs sur l’année 3. Sinon, en contrepartie, AWS ne facturera que les GPUs réellement utilisés et dédommagera l’entreprise A en crédits AWS.

Pro tip: voici la tarification AWS pour les instances cloud IA 👇

Donc d’un côté, les RPOs donnent une énorme visibilité 🔭 sur la demande car on sait à l’avance quelle capacité est nécessaire pour répondre à la demande à un instant T et quel est le chiffre d’affaires minimum qui sera engrangé sur l’année.

Mais d’un autre côté, ces RPOs obligent les fournisseurs de cloud à déployer les capacités sur lesquelles ils se sont engagés, sinon quoi ils devront dédommager 💵 les autres parties prenantes, ce qui impactera de facto les revenus futurs.

Maintenant qu’on sait ça, quand on regarde le montant des RPOs, on comprend beaucoup mieux l’accélération des dépenses.

Il y a une vraie urgence à déployer de la capacité, non seulement pour honorer les contrats et éviter d’impacter les revenus futurs, mais aussi pour capter un maximum de clients, car, une fois qu'on souscrit à un service cloud, il est généralement très difficile d’en changer.

Cependant, même si ce discours est très vrai sur le cloud traditionnel, il est en réalité bien remis en question sur le cloud IA. En effet, sur le cloud traditionnel, on est plus sur un système de PaaS 💻 (Platform as a Service) où les entreprises louent des capacités de calcul via des services, alors que sur le cloud IA, on est beaucoup plus sur un système IaaS (Infrastructure as a Service) où les entreprises louent surtout une infrastructure 🏭 sur laquelle elles vont construire leurs plateformes.

Maintenant, le cloud IA ne peut fonctionner sans cloud traditionnel, ne serait-ce qu’avec l’accès aux bases de données, et reste quand même un mix IaaS + managed services, donc ce système de “lock-in” reste encore bien présent.

⚡ À noter: AWS et GCP ont collaboré pour établir une connexion directe entre leurs datacenters, ce qui permet un transfert de données bien plus rapide, facilitant le multicloud et la migration de leurs clients.

Malgré tout, il faut savoir que les RPOs ne représentent qu’une partie du chiffre d’affaires des fournisseurs de cloud. Comme expliqué tout-à-l’heure, il y a aussi la partie pay-as-you-go 🪙 qui elle est beaucoup plus imprévisible.

La part du pay-as-you-go dans les revenus des CSP varie énormément en fonction du fournisseur. Par exemple, Oracle et Microsoft sont connus pour être très corporate et attirer des clients plus stables, ce qui est moins le cas d’AWS et GCP qui essaient d’attirer les startups. La part des RPOs chez Oracle et Microsoft est donc bien plus importante que chez AWS et GCP.

Pour modéliser au mieux la demande, chaque fournisseur de cloud a son propre modèle prédictif 🤔 qui se base principalement sur la demande passée, ainsi que la charge et la congestion de chaque datacenter.

Ainsi, ils peuvent déterminer quelle zone géographique 🌍 a besoin d’être renforcée en capacité, tout en ayant connaissance du nombre de serveurs manquants pour répondre au mieux à la demande à venir.

Qui profitera de ces CapEx ?

Bon, c’est bien beau tout ça, mais à qui profiteront ces CapEx ? Eh bien principalement à toute l’industrie des semi-conducteurs, que ce soit:

Les ODMs (Original Device Manufacturers) qui achètent les composants et assemblent les serveurs et autres matériels informatiques en fonction du cahier des charges des CSP (Foxconn/HonHai, Wiwynn, Wistron, Quanta, Celestica, Accton, HPE, Dell, Super Micro)

Les “fabless”, c’est-à-dire Nvidia pour les GPUs, AMD pour les GPUs et les CPUs, Broadcom pour les puces réseau

Les co-designers, c’est-à-dire les entreprises qui conçoivent les ASIC conjointement avec les CSP (Marvell, Broadcom, AlChip, MediaTek)

Les fournisseurs de matériel réseau, que ce soit via les switch/routers (Arista Networks, HPE, Nvidia, Cisco, Ciena), via les optiques (DSP/PHY chez Broadcom, lasers et modules chez Lumentum, Coherent, Fabrinet, Eoptolink, Innolight) ou bien via les câbles (Corning, Credo)

Les fonderies et IDMs (Integrated Device Manufacturers), comme TSMC, Intel (surtout pour les CPUs), Samsung (surtout pour la mémoire), SK Hynix et Micron

Les OSATs (Outsourced Semiconductor Assembly and Test), comme KYEC, Amkor, ASE Holdings

Les équipementiers (la demande en puces augmente donc il faudra plus d’équipements pour les fabriquer), comme ASML, BE Semiconductors, Lam Research, ASM International, ASMPT, Advantest, Teradyne, KLA Corporation ou Applied Materials

Et plein d’autres encore comme les acteurs de la chimie (Air Liquide, Linde, AXTI, …)…

Les industries de la construction 🏗 et de l’énergie 🔋 vont aussi en profiter mais ça restera marginal et la part du lion sera vraiment captée par 3 acteurs: Nvidia, TSMC et Broadcom.

Nvidia, car ils ont un quasi monopole sur les accélérateurs IA avec environ 60-70% de la puissance de calcul installée mais qui capte plus de 90% des revenus du secteur (sans parler de leur branche networking qui est en pleine explosion).

Broadcom, car ils sont prédominants sur le networking, notamment avec leurs puces Tomahawk 5 et 6 mais aussi avec leurs optiques, et qu’ils sont leader sur la co-conception des ASIC et notamment en charge des TPUs de chez Google, qui sont à ce jour le programme le plus avancé et réussi.

TSMC, car ils sont en quasi monopole sur la fabrication et le packaging des puces avancées (7nm et moins) avec plus de 95% de parts de marché. Peu importe le gagnant 🥇 au niveau des puces, elles seront forcément fabriquées par TSMC.

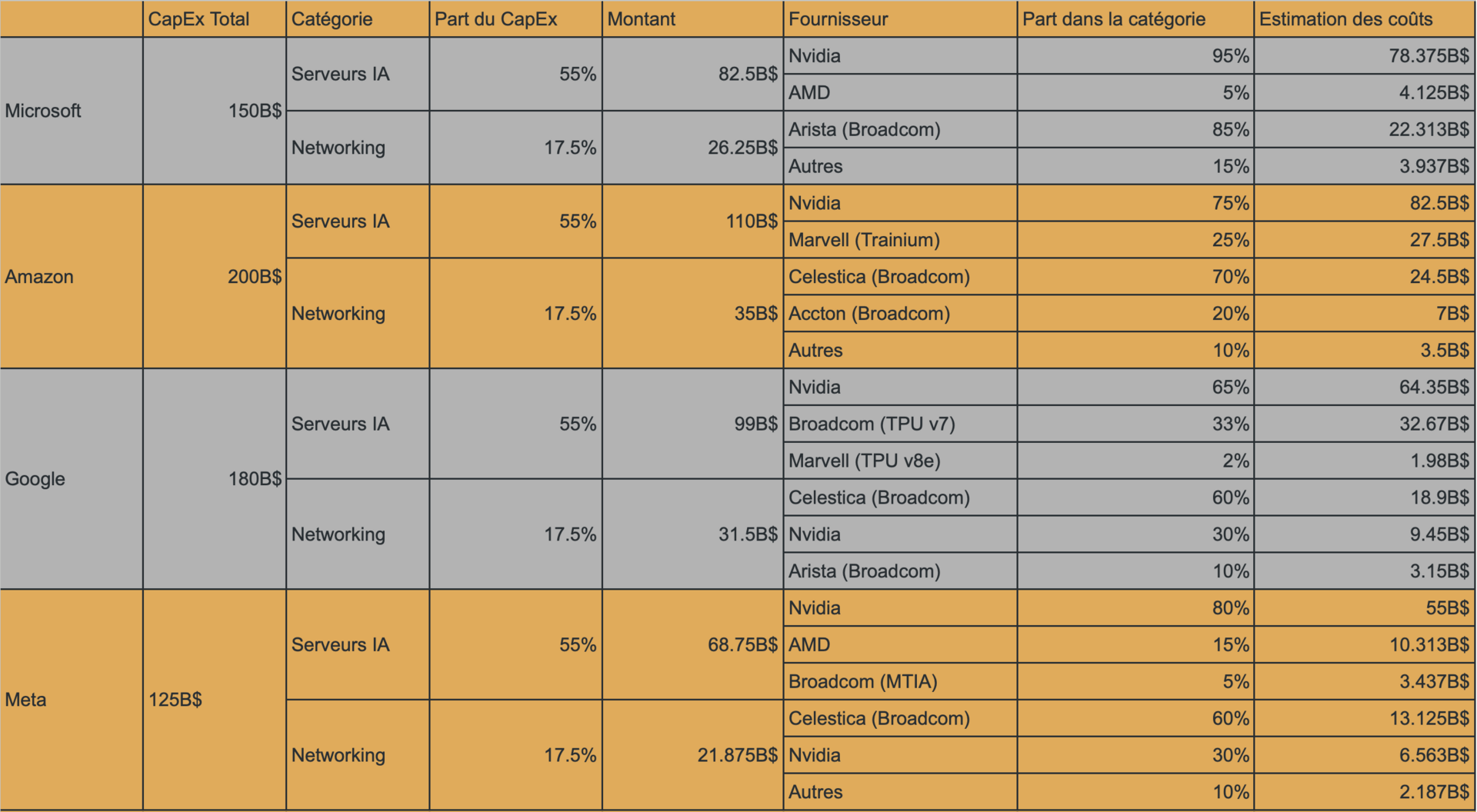

Si on se concentre maintenant sur Nvidia, Broadcom et AMD (c’est les plus simples à estimer), on sait qu’environ 60% de ces CapEx seront redirigés vers les serveurs (55% sur les serveurs IA) et environ 15-20% seront alloués vers le networking.

Si on fait un “breakdown” par hyperscaler, on devrait avoir quelque chose comme suit:

Estimation de la répartition des CapEx par fournisseur

⚠ Attention, il s’agit ici d’ordres de grandeur pour estimer le coût que pourrait représenter chaque fournisseur. Derrière, il faut compter la part des ODMs et autres fournisseurs de matériel annexe (comme les PSUs, etc…)

Donc au total, Nvidia devrait capter environ 280B$ (en estimant que Nvidia capte ~95% de la valeur), AMD environ 13B$ (en estimant qu’AMD capte ~90% de la valeur), Marvell environ 8.85B$ (en estimant que Marvell capte ~30% de la valeur), et Broadcom environ 49B$ sur le networking et 22B$ sur les ASIC (en estimant que Broadcom capte ~50% et ~60% de la valeur respectivement). Et tout ça, sur 4 clients uniquement 🤯 …

Que tirer de tout ça ?

Il est probable que ces dépenses colossales fassent passer les hyperscalers dans le rouge 🔴 , avec des FCF négatifs pendant une période indéterminée. Dans cette optique, le marché devrait repricer les multiples de valorisation 🔻 de ces entreprises et il est plausible qu’elles sous-performent l’indice à court-moyen terme, surtout qu’il ne faudra pas forcément compter sur les rachats d’actions pour soutenir les cours.

Cependant, ces entreprises sont en train de bâtir un empire 👑 , et, même si les dépenses en investissement devraient continuer sur le long terme, la rentabilité reste présente et la croissance se matérialise.

Ce désamour par le marché devrait offrir des opportunités aux investisseurs patients, capables de tenir sur le long terme leur position.

Par ailleurs, on peut aussi se poser la question de la stratégie de la puissance de calcul. Aujourd’hui, cette puissance de calcul sert à “créer de l’intelligence” 🧠 et assez peu d’entreprises l’implémentent pleinement. Que se passera-t’il quand tout le monde voudra y avoir accès ?

Les hyperscalers seront totalement indépendants là dessus et s’ils estiment pouvoir obtenir un meilleur ROI en conservant pour eux la puissance de calcul, ils ne se priveront pas alors que les entreprises clientes pourraient se retrouver dans l’incapacité d’accéder à une puissance de calcul suffisante pour leurs besoins.

Alors, oui, les CapEx pèsent 🔽 sur les finances à court terme et continueront de peser sur le long terme, notamment via les dépréciations. Mais le business model des hyperscalers se renforce, et ces entreprises nous montrent clairement qu’elles savent penser long terme.

Quoiqu’il en soit, on observe aujourd’hui un déplacement ➡ de la création de valeur dans le haut de la chaîne de production. Pendant des années, le matériel et les semiconducteurs représentaient un marché commoditisé, avec une création de valeur s’effectuant en bout de chaîne par le biais de services, comme les PaaS et SaaS.

Aujourd’hui, seule une poignée d’entreprises est capable de fournir le matériel nécessaire pour produire cette intelligence et ça se ressent clairement dans leurs marges.

Le plus étonnant étant que leurs valorisations ne sont pas particulièrement élevées (on parle de 25 fois les bénéfices 2026 pour Nvidia - soit la moyenne du marché, avec une croissance ~7-8 fois supérieure), malgré une demande explosive 💥 , comme en témoignent les prévisions de CapEx des hyperscalers.